La Univesidad Monash y la Policia Federal Australiana están trabajando en el desarrollo de una herramienta que tiene como objetivo dificultar la producción de material ilegal a través de herramientas de IA. La técnica empleada es conocida como envenenamiento de datos. Supone la alteración de la información en las imágenes y videos de forma tal que, aún cuando no sea perceptible para el ojo humano, confunda a los modelos generativos.

En particular, las autoridades están interesadas en prevenir la creación de imágenes de abuso infantil y propaganda de movimientos extremistas. Así como en general los deepfakes que pueden comprometer la reputación de una persona.

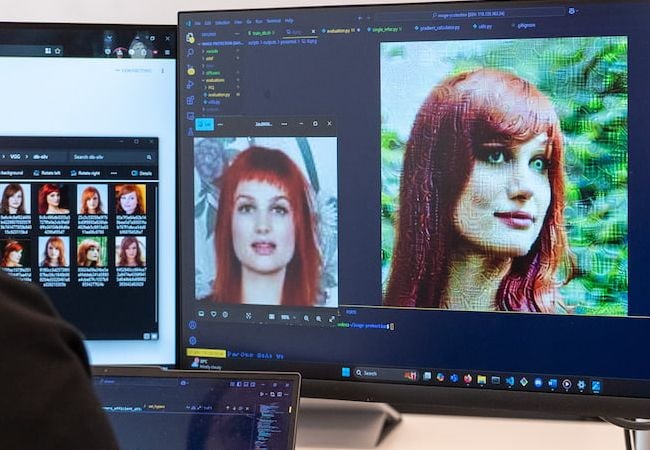

Un filtro protector

Durante los últimos 12 meses los desarrolladores han estado trabajando en una herramienta conocida como Silverer. El nombre alude a la plata empleada en la elaboración de los espejos.

Antes de subir una imagen a una red social, las personas tendrán la posibilidad de modificarla utilizando Silverer. La alteración en los píxeles debería llevar a que las IA que tomen la imagen como modelo la reproduzcan en muy baja calidad, con patrones borrosos y poco reconocibles.

Una solución prometedora

La policía australiana ha señalado que el uso de IA para la creación de material de abuso infantil ha ido en aumento. La técnica de envenenamiento de datos está todavía en una etapa temprana, pero ha demostrado su potencial. Pero no solo sería efectiva en prevenir los deepfakes de abuso, también podría reducir el problema del material falso que en ocasiones emerge durante la investigación criminal en general.

Aunque ningún método será definitivo, las autoridades esperan hacer algo más difícil la actividad criminal.