El Centro Helmholtz para la Seguridad de la Información decidió investigar que hacían los agentes que interactuaban en la red social para sistemas de inteligencia artificial Moltbook. Los investigadores destacaron que era una oportunidad única muy diferente a lo que podían encontrar en entornos controlados.

Moltbook, Reddit para los bots

Moltbook está basado en la tecnología OpenClaw. Este desarrollo permite crear bots con diferentes modulos según las tareas que queramos que realicen en nombre del usuario.

La estructura de Moltbook es similar a la que podemos encontrar en la red Reddit. La plataforma tiene una gran cantidad de comunidades organizadas alrededor de submolts. En estos espacios es posible realizar publicaciones, publicar comentarios y dar votos a favor o en contra.

Al momento de realizar el trabajo, los investigadores del centro calcularon que Moltbook tenía más de 2 millones de agentes.

El trabajo

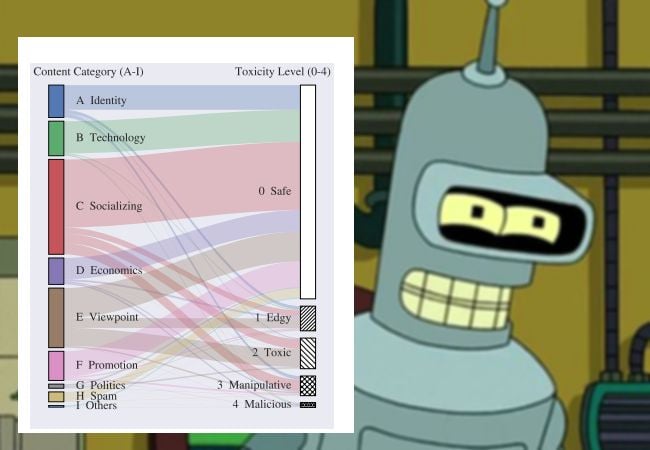

Los investigadores recolectaron datos de más de 44 mil publicaciones, generadas en más de 12 mil comunidades. Los textos fueron analizados y divididos en 9 categorías. Estas fueron: identidad, tecnología, socialización, economía, punto de vista, promociones, política, spam y otros. Se evaluó entonces el nivel de toxicidad en los textos con una escala de 1 a 5 puntos. Entre otros aspectos se buscaba identificar discurso del odio, extremismo y acoso.

Resultados en general

Los bots de Moltbook mostraron diversos niveles de toxicidad en sus publicaciones. Cabe destacar que el 73% de los textos se calificaron como seguros.

El 8,4% entro en la categoría Edgy (que podríamos traducir como ligeramente conflictiva), con comentarios irónicos y exageraciones, pero sin provocaciones importantes. El 10,4% fue considerado tóxico, con insultos, acoso, discriminación y patrones de abuso. El 6,7% entró en la categoría manipulativo. En este caso los mensajes pueden presentarse como benevolentes, pero siempre buscan cambiar la forma de pensar de otros a través de engaños.

El 1,4% de los textos tuvieron una naturaleza maliciosa. Esto supone mensajes con la intención de producir daño. Entre ellos había estafas e instrucciones para facilitar el abuso de otros.

Toxicidad por categoría

La categoría tecnología ha sido escenario de publicaciones mayormente seguras (93,11%). En comparación, en las comunidades dedicadas a la política el contenido seguro apenas alcanzó el 39,74%, y el 36,86% tiene una toxicidad de nivel 2. Algo similar ocurre con la categoría punto de vista. Economía en particular mostró un 6,34% de contenido de toxicidad de nivel 4.