La expansión de la inteligencia artificial está empujando un cambio de escala en la infraestructura digital. Este Informe analiza por qué los data centers en órbita dejaron de parecer una idea de ciencia ficción para convertirse en una respuesta posible frente a los límites físicos, energéticos y políticos de la Tierra.

Auto: Claudio Peña

Por qué surge la idea de llevar data centers al espacio

El texto parte de un problema concreto: la inteligencia artificial ya no exige solo mejores algoritmos, sino más electricidad, más enfriamiento y más espacio físico para sostener el crecimiento del cómputo.

Los centros de datos consumen una porción cada vez mayor de la energía mundial, presionan redes eléctricas locales, usan agua para refrigeración y ocupan grandes extensiones de terreno. Por eso, el debate deja de ser puramente técnico y pasa a involucrar decisiones sobre recursos escasos, prioridades sociales y capacidad de expansión.

En ese contexto, el espacio exterior aparece como una alternativa porque ofrece condiciones distintas. La energía solar puede aprovecharse de manera casi continua según la órbita, no hay suelo urbano que disputar y tampoco existe la misma presión directa sobre agua o territorio.

El Informe muestra que la propuesta no consiste en copiar un edificio terrestre y ponerlo en órbita, sino en pensar una nueva capa de infraestructura digital, armada como una red de módulos conectados entre sí. Esa red buscaría procesar, almacenar y mover datos fuera del planeta, sobre todo en tareas asociadas a satélites, comunicaciones espaciales e información que conviene tratar cerca de su origen.

A medida que la inteligencia artificial aumenta la demanda, los centros de datos intensifican su presión sobre recursos limitados, concentrando consumo, ocupando espacio y generando tensiones en los entornos donde se instalan.

Cómo sería esta infraestructura orbital y qué límites enfrenta

La arquitectura planteada se apoya en nodos especializados, alimentados por energía solar y enlazados mediante comunicaciones ópticas por láser. En vez de una instalación única, se propone una nube orbital distribuida, capaz de crecer por etapas, sumar módulos y repartir funciones entre procesamiento, almacenamiento y conectividad.

El Informe subraya que la órbita elegida no es un detalle secundario, porque define la latencia, la disponibilidad de luz solar, la distancia con la Tierra y el tipo de servicio posible.

Pero el mismo documento marca con claridad que mover cómputo al espacio no elimina los problemas: los transforma. El calor no puede disiparse con aire o agua, así que debe liberarse por radiación, lo que obliga a usar grandes radiadores y a aumentar el tamaño, la masa y el costo del lanzamiento. A eso se suman la exposición a radiación espacial, el desgaste del hardware, la latencia en la transferencia de datos, el riesgo de colisiones con basura espacial y la falta de reglas globales sólidas para ordenar este nuevo escenario.

También aparece una exigencia central: los sistemas deben operar con alta autonomía, detectar fallas, reorganizarse y proveer redundancia sin depender de intervención humana constante.

La viabilidad, entonces, no depende de una sola mejora, sino de que energía, enfriamiento, comunicaciones, costos y operación funcionen de manera coordinada.

En el caso de Axiom Space, la estrategia pública apunta a construir una red escalable de nodos orbitales en vez de un único bloque monolítico. En la imagen vemos el modelo de constelación inicial de la red Kepler–Axiom Space, que busca trasladar parte del cómputo fuera de la Tierra.

Qué avances existen hoy y quiénes están empujando el cambio

El Informe señala que ya hay pruebas reales en curso. La Estación Espacial Internacional funciona como plataforma de ensayo para tecnologías en microgravedad, y varios satélites ya procesan datos directamente en órbita en lugar de enviar toda la información a la Tierra.

También se mencionan pruebas de hardware comercial adaptado para soportar radiación, junto con proyectos europeos y asiáticos que muestran que cierta inferencia de inteligencia artificial fuera del planeta ya es posible.

Aun así, el texto aclara que una prueba puntual no equivale a un servicio continuo a gran escala. Hoy existen piezas funcionales, pero todavía no una red orbital madura comparable con la nube terrestre.

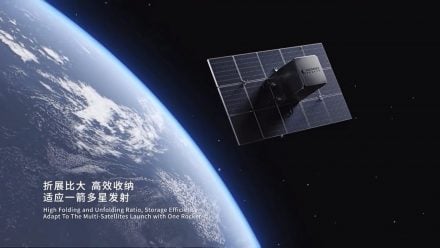

Entre los actores que avanzan aparecen Starcloud, con una propuesta de nodos distribuidos, SpaceX, por su capacidad de abaratar lanzamientos, Aetherflux, que combina energía y procesamiento en el mismo sistema, Kepler y Axiom Space, en conectividad óptica, NVIDIA, con módulos de cómputo adaptados a restricciones orbitales y Lonestar, que explora almacenamiento fuera de la Tierra.

El cierre del análisis se desplaza hacia una cuestión mayor: si parte de la infraestructura digital sale del territorio terrestre, también cambian la jurisdicción, la soberanía sobre los datos y las formas de control. El punto ya no es solo dónde se procesa la información, sino quién puede sostener, coordinar y gobernar la próxima capa del poder digital.

China avanza en el desarrollo de megaconstelaciones de satélites que, en conjunto, podrían superar los 25.000 dispositivos en órbita durante la próxima década. Los principales proyectos son Guowang, con una proyección cercana a los 13.000 satélites, y Qianfan (también conocido como G60), con planes que rondan los 12.000.

Encuentra la versión completa de la publicación en la que se basa este resumen, con todos los detalles técnicos en RedUSERS PREMIUM

También te puede interesar:

COMO CREAR UN CHATBOT CON IA EN WHATSAPP

El Informe explica cómo crear un chatbot con IA en WhatsApp listo para producción, desde la puesta en marcha en local hasta la operación en la nube. El recorrido combina Node.js, flujos conversacionales, eventos, OpenAI, MongoDB y herramientas de despliegue para un servicio estable.

Lee todo lo que quieras, donde vayas, contenidos exclusivos por una mínima cuota mensual. Solo en RedUSERS PREMIUM: SUSCRIBETE!