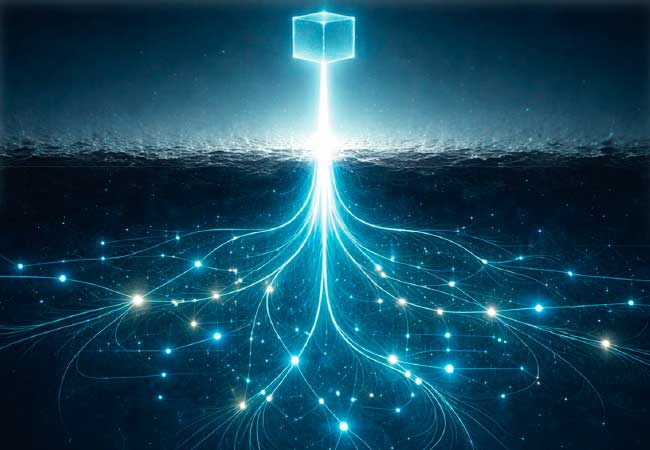

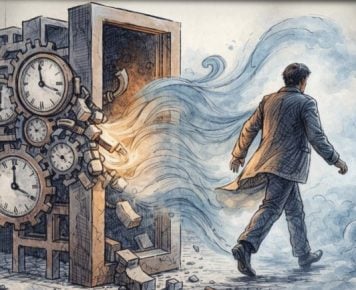

El Informe explica cómo cambió la manera de evaluar a los modelos de inteligencia artificial: ya no alcanza con mirar qué responden, también importa cómo organizan el proceso interno que les permite llegar a esa respuesta.

Autor: Elisa Belmar

Qué es el razonamiento profundo y por qué importa

El texto define el razonamiento profundo como un proceso interno en el que el modelo no responde de forma inmediata, sino que desarma el problema, compara caminos posibles y luego arma una salida con continuidad. Esa diferencia se vuelve clave cuando la tarea exige varios pasos conectados, como resolver problemas encadenados, escribir código que debe funcionar como un conjunto o analizar mucha información sin mezclar planos distintos.

En esos casos, la calidad no depende solo del dato final, sino de la capacidad de sostener el orden y la consistencia, durante el proceso.

El Informe muestra que este tipo de trabajo interno permite evitar respuestas apuradas, conservar mejor la lógica del desarrollo y dar más solidez a tareas largas o técnicas.

En todos estos escenarios, la respuesta no puede surgir de forma inmediata. Requiere un recorrido previo que permita organizar el contenido antes de expresarlo. El razonamiento profundo es ese recorrido, aunque no siempre sea visible para quien recibe la respuesta.

Cómo razonan Gemini y ChatGPT

En Gemini, sobre todo en sus versiones más nuevas, el Informe describe una lógica de expansión inicial del problema. El sistema toma la instrucción, la amplía con contexto implícito, abre varias rutas posibles y sostiene desarrollos largos antes de cerrar una respuesta. Esa forma de trabajo aparece como útil cuando hay que considerar alternativas, mantener la coherencia en procesos extensos o integrar cambios sin romper lo ya construido.

También se menciona Gemini Deep Think como un modo pensado para dedicar más tiempo de cómputo a preguntas complejas, diseño técnico, programación y análisis con varias condiciones.

En ChatGPT, en cambio, el texto señala una dinámica más adaptable. El modelo evalúa primero la dificultad de la tarea y regula cuántos pasos internos necesita. Si el pedido es simple, responde con un recorrido corto, si es más exigente, amplía el desarrollo.

En lugar de abrir muchas posibilidades durante demasiado tiempo, suele consolidar bastante rápido una línea principal y avanzar por esa ruta dominante. Esa elasticidad permite combinar rapidez y elaboración dentro del mismo sistema.

El modo ChatGPT Thinking aparece, según el informe, como la opción más conveniente cuando hace falta revisar la consistencia, comparar caminos, depurar errores complejos o construir respuestas donde equivocarse cuesta caro.

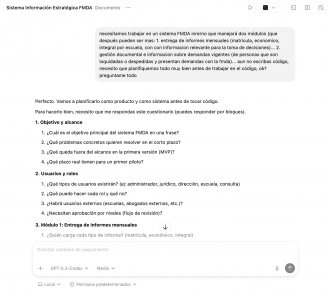

El prompt obliga al modelo a sostener una misma estructura a lo largo de todo el desarrollo, reutilizando los elementos definidos desde el inicio. Esto permite observar si mantiene coherencia entre los pasos, evita redefiniciones y es capaz de integrar cambios sin romper lo construido previamente.

Costos, límites y cambio de criterio

El Informe también remarca que razonar más tiene costo. Cada paso interno consume tiempo de cómputo, memoria y energía, por eso la latencia no depende solo de cuánto texto se ve en la respuesta, sino de cuántas operaciones ocurrieron antes. Desde esa mirada, la diferencia entre modelos no pasa únicamente por si “piensan más” o “piensan menos”, sino por cómo administran ese recurso. Algunos sostienen procesos más extensos desde el inicio; otros ajustan la profundidad sobre la marcha para no gastar capacidad de más.

A la vez, el texto marca límites claros. Una respuesta puede estar muy bien armada y aun así ser incorrecta. El modelo puede seguir una lógica prolija, pero partir de una premisa equivocada o aplicar mal una regla. Además, cuando el desarrollo se alarga, la estabilidad puede aflojarse: una pequeña desviación al comienzo puede arrastrarse hasta el resultado final.

También hay un problema de trazabilidad, porque la explicación que el sistema da en lenguaje natural no es un registro exacto de todas sus operaciones internas.

Por eso, el Informe propone un cambio de criterio para analizar inteligencia artificial. El valor ya no está solo en la cantidad de información que el modelo maneja, sino en cómo ordena ese saber antes de responder. La gestión del razonamiento aparece así como el nuevo diferencial práctico: decidir cuánto desarrollar, cuándo abrir alternativas y en qué momento cerrar una respuesta sin perder calidad.

El problema no es que el razonamiento falle de forma evidente, sino lo contrario: que funciona de manera suficientemente ordenada como para resultar creíble. La estructura interna de la respuesta da la impresión de solidez, aunque el contenido no sea válido.

Encuentra la versión completa de la publicación en la que se basa este resumen, con todos los detalles técnicos en RedUSERS PREMIUM

También te puede interesar:

LAS NUEVAS REGLAS DE LA ABUNDANCIA

Este informe analiza cómo la inteligencia artificial y la automatización empiezan a cambiar la lógica de escasez que organizó durante décadas el trabajo, los ingresos y el acceso a la vida cotidiana, abriendo una etapa donde cambian las reglas económicas y sociales.

Lee todo lo que quieras, donde vayas, contenidos exclusivos por una mínima cuota mensual. Solo en RedUSERS PREMIUM: SUSCRIBETE!