Blender es el nombre del nuevo chatbot de Facebook.

Para su entrenamiento la compañía utilizó más de 1.500 fragmentos de comunicaciones entre seres humanos ocurridos en Reddit. Esto es el equivalente moderno a sacrificar cientos de vidas humanas en un ritual satánico y esperar que algo bueno pase.

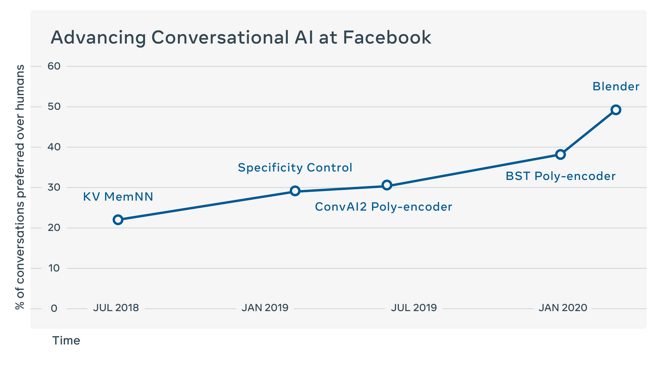

Según Facebook en sus pruebas el 49% de las personas señaló que prefería las interacciones con Blender a las que había tenido con otro ser humano.

Algunos problemas

La iniciativa ha encontrado varias críticas señalando los inconvenientes del método empleado.

En ocasiones Blender respondió con lenguaje ofensivo.

Blender también ha creado datos falsos para sus respuestas.

Blender actuando como Bender. Pueden besar su brillante trasero.

Los desarrolladores han admitido que existen algunos problemas, pero que esperan que en las siguientes versiones sean solucionados.

Dave Coplin, experto en inteligencia artificial para la consultora The Envisioners, señaló que Blender era un paso en la dirección correcta. Sin embargo, también apuntó que el proyecto debe considerar algunas cuestiones fundamentales como la capacidad de mantener una conversación. La base de datos utilizada también supone un problema, dado que una parte del material puede producir efectos nocivos.

Comparativa

Facebook comparó Blender con Meena, el chatbot de Google. Para ello le mostró a un grupo de personas dos series de conversación generados uno por cada modelo. Las charlas incluían varios temas.

Según Facebook el 67% de los consultados señalaron que Blender parecía más humano que Meena.

Blender debe su nombre a la intención de sus desarrolladores de combinar varias habilidades de conversación.