Miguel Nathan Licht es el presidente del Tribunal Fiscal de la Nación en Argentina. Es también uno de los candidatos a ocupar un puesto en la Corte Suprema. Sin embargo, esta posibilidad puede haberse reducido significativamente por culpa de un manejo descuidado de la inteligencia artificial.

La historia la hemos visto en varias ocasiones, abogados e IA no terminan bien.

El libro y los libros que no existen

Licht presentó en redes sociales un libro de su autoría en dos tomos. Tratado de interpretación constitucional: aportes de la Halajá en la interpretación jurídica. Aunque el texto tiene mucho de perspectiva personal, lo cierto es que los escritos de los magistrados son de mucha influencia en el trabajo de los abogados y las decisiones que toman las cortes. A menudo aparecen citados.

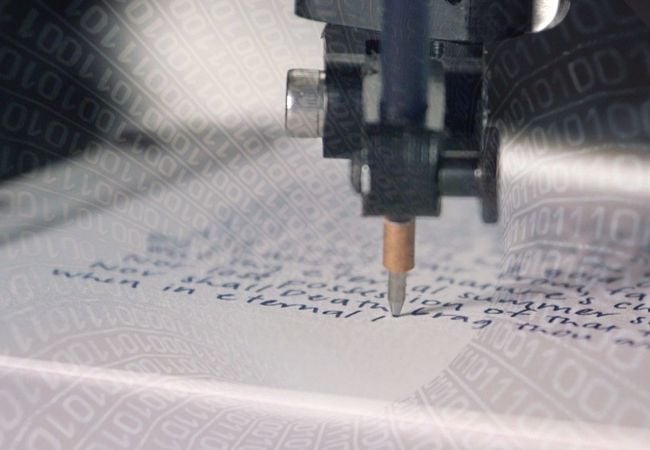

Ahora bien, el trabajo de un abogado puede ser muy arduo y el tiempo libre escaso. Por otro lado escribir un libro supone un gran esfuerzo y dedicación. Mucho puede mejorar la situación en estos casos el uso de un ghostwriter, un escritor fantasma que ayuda con la redacción de un libro. En teoría una IA también puede realizar esta tarea, pero la escala de trabajo y complejidad es tal que supera los límites de fiabilidad de la tecnología.

Las críticas al libro de Licht fueron variadas, pero se destacaron los señalamientos a las imprecisiones y varias citas a libros inexistentes. Dos de los libros que no existen son atribuidos a uno de los ministros de la Corte Suprema, Carlos Rosenkratz.

El reconocimiento

Licht se defendió señalando que “la desprolijidad, el apuro y alguna intervención poco feliz de la IA pudieron jugarme una mala pasada”. Y mantuvo que el libro fue escrito con honestidad intelectual.

Aún considerando la mejor de las intenciones, apuro, desprolijidad e IA (mal manejada) no son elementos que esperamos en un juez. Quienes hemos participado en la elaboración de libros sabemos que existen muchas instancias de lectura, revisión y perfeccionamiento. Los errores pueden ocurrir, pero en este caso parece que la inteligencia artificial hizo lo que quiso y nadie la supervisó.

No es la primera, ni la segunda, ni la tercera vez, y seguramente no será la última vez que algo malo ocurra por el empleo de las IA en el ámbito legal.

De hecho en septiembre una corte de General Roca sancionó a ambas partes en un litigio por presentar textos con referencias inventadas, generadas con IA.