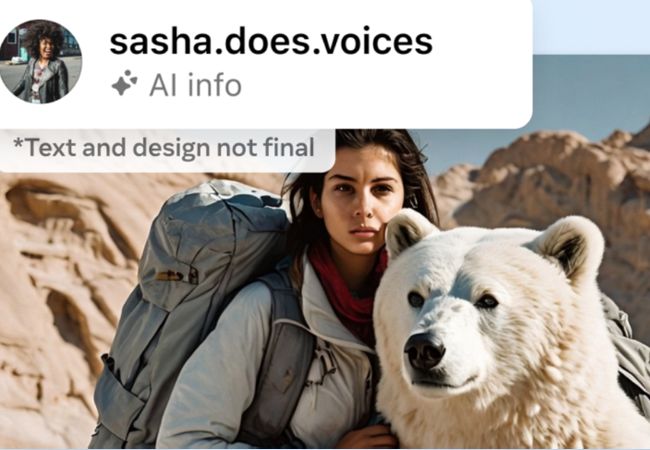

Meta ha anunciado la implementación de una nueva tecnología que le permitirá identificar y etiquetar las imágenes generadas por la inteligencia artificial de otras empresas. Hasta ahora podía hacerlo con facilidad con las imágenes que generaban sus propios modelos. El sistema funcionará en Facebook, Instagram y Threads.

El sistema

Actualmente cuando las IA de Meta crean imágenes realistas incluyen en ellas marcadores visibles, marcas de agua invisibles y metadatos. Las marcas permiten que tanto el público como los sistemas de las plataformas puedan identificar la naturaleza del contenido.

Lo que ha hecho la compañía es trabajar con otras empresas para establecer estándares en común para los marcadores empleados en las imágenes. Entre las firmas involucradas aparecen: Google, Microsoft, OpenAI, Midjourney y Shutterstock. El resultado es que una imagen publicada en un servicio podrá ser identificado como generado por una IA en otro.

Las herramientas para aprovechar esta nueva posibilidad técnica no están todavía desarrolladas a pleno. Pero Meta espera que estén disponibles durante los próximos meses.

Labeling AI-Generated Images on Facebook, Instagram and Threads

Eficacia a comprobar imágenes falsas

Para saber el verdadero impacto de estos estándares y las herramientas asociadas habrá que esperar. Es muy probable que sean efectivos para las imágenes generadas de un modo sencillo. Sin embargo, algunos críticos han apuntado que son útiles para tratar con el material de modelos específicos. Además, la aplicación de procesos posteriores podría eliminar las marcas.

Por otro lado, Meta todavía debe resolver el problema de los videos y audios generados por IA.

Las políticas contra el contenido falso de Meta son incoherentes